Studiedesign

Contents

Studiedesign#

Studiedesign refererer til den overordnede planen eller strukturen for hvordan en studie skal gjennomføres. Det beskriver metoder for innsamling, analyse og tolkning av data, og sikrer at spørsmålene kan besvares på en pålitelig måte. Valget av studiedesign avhenger av spørsmålet, målsettingen med studien og hvilke type data som trengs.

Studietyper#

Overordnet underdeler vi i to typer studier. I observasjonsstudier observerer vi hva som skjer uten at vi påvirker det. I intervensjonsstudier derimot behandler vi to eller flere grupper på forskjellige måter og undersøker effekten av denne forskjellige behandlingen.

Intervensjonsstudier#

Den første studietypen vi skal se på er randomiserte kontrollerte studier eller A/B-tester. Det er en type intervensjonsstudie, der vi i begynnelsen av studien deler studiedeltagere tilfeldig inn i to grupper, en gruppe som får behandling A og en gruppe som får behandling B. Så venter vi og sammenligner utfallet etter et visst tidspunkt. Typiske eksempler av denne typen studie er når vi tester om legemiddler virker eller når vi sjekker om en nettbutikk selger flere varer ved å endre på hvilken farge kjøp-knappen har.

En randomisert kontrollert studie er en intervensjonsstudie. Vi har alltid en klar definert studiepopulasjon og resultatene gjelder kun for denne populasjonen. Det er viktig å gjøre deling i gruppene helt tilfeldig. Så gjør vi forskjellige intervensjoner eller behandlinger i de forskjellige gruppene. Til slutt kan vi analysere den kausale effekten av en intervensjon.

Fordi de to gruppene er delt inn tilfeldig, så er all forskjell i utfall på grunn av intervensjonen. Vi kan altså se på intervensjonen som årsak av utfallet. For å gjøre det, så bruker vi hypotesetester, regner ut hvor stor effekten er og hva som er konfidensintervallet av effekten. Spesielt i medisinske studier kan det være sånn at folk blir tilfeldig tildelt en behandling, men av et eller annen grunn så får de faktisk den andre behandlingen. Her kan det virke fristende å analysere behandlingen som folk faktisk fikk heller en behandlingen de ble tilfeldig tildelt. Det kalles for per protokoll analyse. Men det er som oftest analysen som bruker den tilfeldig tildelte behandlingen, altså intensjon om å behandle analysen, vi er mest interessert i. Det er fordi når en lege skal velge hvilken behandling de skal anbefale pasienten å ta, så tilsvarer det mest den tildelingen av behandlingen i studien. Så kan det igjen være at pasienten faktisk får den andre behandlingen, for eksempel på grunn av bivirkninger.

Intervensjonsstudier er den beste studietypen for å vise at en årsak har en viss virkning. Men det er ikke alltid vi kan gjøre det. For det første, så er det uetisk å gjennomføre en randomisert kontrollert studie som utsetter en av gruppene for fare. For det andre, så kan dette være utrolig dyrt og vi kan kun se på en behandling om gangen.

Observasjonsstudier#

Tversnittsstudier#

En type observasjonsstudie er en tversnittsstudie. Der observerer vi studiepopulasjonen på et bestemt tidspunkt.

Dette er kun en beskrivende studie, der vi ikke kan si noe om årsak og virkning. Men på den positive siden, så er det enkelt å samle inn data og vi kan se på sammenhenger av mange variabler samtidig. Et eksempel som vi har sett på tidligere er data om huspris. En ulempe er at data kan være ganske ubalansert, for eksempel hvis vi vil undersøke om røyking og tarmkreft er korrelerte, så er det heldigvis sånn at folk flest ikke har tarmkreft og hvis vi prøver å gjøre en tversnittstudie på dette, så trenger vi utrolig mange personer i studien for å ha nok personer som faktisk har tarmkreft.

Når vi har gjennomført en tversnittsstudie prøver vi typisk å predikere en variabel basert på de andre variablene.

Kohortstudier#

En kohortstudie er en observasjonsstudie der vi følger folk (eller ting) over tid. Her starter vi med en studiepopulasjon og beskriver de på tidspunktet de ble inkludert i studien. Vi kan for eksempel se om de er utsatt for en miljøgift eller ikke. Så følger vi de over tid. Til slutt sammenligner vi om de hadde forskjellige utfall.

Studiepopulasjon kan være alt mulig, for eksempel pasienter, brukere, fisk, byer, og så videre. Fordelen er at vi ofte har mye data tilgjengelig og at vi følger studiepopulasjonen over tid. Men det kan fortsatt ikke fastslå om miljøgiften er årsaken av en senere sykdom. Det kan være at for eksempel fattige folk er mer utsatt for en type miljøgift og samtidig mer utsatt for sykdom. I så fall er det ikke nødvendigvis miljøgiftet som forårsaker sykdommen men en annen variabel som forårsaker både miljøgift og sykdom. Et eksempel er den norske mor, far og barn-undersøkelsen, som inkluderer over 100 000 svangerskap i perioden 1999–2008 med formålet å få mer kunnskap om mulige årsaker til sykdom og helseskade. Et annet eksempel er å forutse om folk vil slutte å bruke et nettsted for å kunne gi ekstra tilbud til de som holder på å avslutte et kundeforhold.

Når vi analyserer kohortstudier, så prøver vi ofte å predikere utfall basert på variablene som ble målt før. I tillegg ser vi ofte på hypotesetester om det er forskjeller mellom variablene avhengig av utfallet.

Case-control-studier#

Den siste typen observasjonsstudie vi ser på er case-control-studier. Her ser vi på studiedeltagere med en viss utfall. Det kan for eksempel være folk med en type sjelden sykdom. Dette kalles for cases. Så ser vi på en tilfeldig utvalgt gruppe som ligner på cases, altså for eksempel er like gamle og har samme kjønn, men ikke har utfallet. Det kalles for controller. Så går vi tilbake i tid og ser på egenskaper av de studiedeltagere før de fikk utfallet. Dette gjøres for å finne om det var noe i fortiden som kan ha forårsaket utfallet. Denne type studien blir veldig ofte brukt for sjeldne utfall, siden en kohortstudie eller tverrsnittsstudie ville trengt veldig mange deltagere for å oppdage en eneste case. Et eksempel vi har sett på tidligere er titanic-data.

Her kan vi igjen bruke hypotesetester og korrelasjoner for å finne hva som er relatert med å være en case. Vi kan også se om vi kan predikere utfallet basert på egenskaper fra før.

Studiestørrelse#

Når vi lager en studie må vi alltid først tenke på type studie og så på hvor mange studiedeltagere vi trenger for å kunne oppnå målene våre. Det finnes måter å velge det ut basert på statistiske grunnlag. Men det krever at vi bestemmer hvordan vi analyserer data før vi samler de inn og at vi bestemmer oss for hva slags effekt av en variabel på en annen som vi vurderer som relevant. Det finnes hele bøker skrevet kun om bestemmelse av utvalgsstørrelse og vi har ikke mulighet å gå dypere inn i dette i dette faget. Det eneste som dere må vite er at vi må tenke på det før vi samler inn data og at hvis vi vil sammenligne to grupper, så er det gruppestørrelsen av den minste gruppen som er mest relevant for hvor mye vi kan si om forskjeller mellom gruppene.

Datainnsamling#

Det viktigste å tenke på når deg gjelder datainnsamling er hvilke data som skal samles inn. Og hovedbudskapet her er at vi trenger å samle inn alle de relevante variablene men må ikke samle inn for mange irrelevante variabler.

Simpsons paradoks#

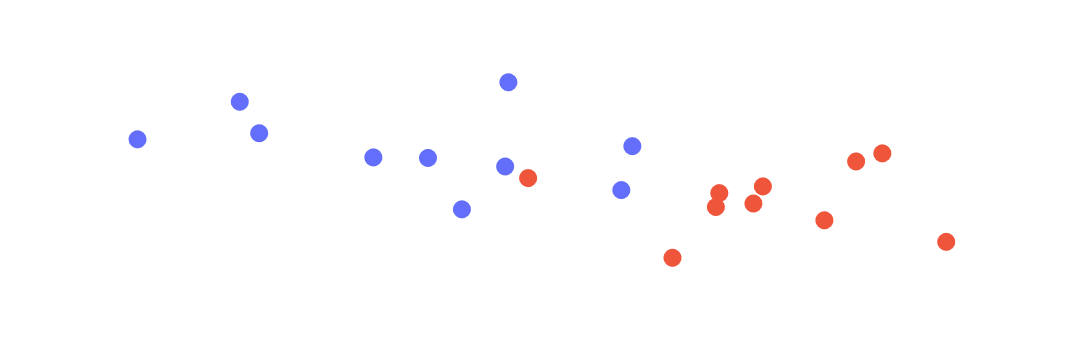

En grunn for at vi alltid vil samle inn alle de relevante variablene er Simpsons paradoks. Her ser vi på sammenheng mellom to variabler x og y. Vi er interesserte i hvordan y avhenger av x. Hvis vi bare har målt de to variablene, så er det åpenbart at jo høyere x er, jo lavere er y. En enkel lineær regresjon bekrefter dette. Men hvis vi i tillegg har målt en kategorisk variabel med fem kategorier, så ser vi at for hver kategori så er det sånn at jo høyere x er, jå høyere er også y. Så for hver kategori er x og y positivt korrelerte men når vi ser på alle kategoriene samtidig, så er de negativt korrelerte.

Her er et faktisk eksempel der dette skjer. I en kohortstudie som undersøkte behandling av nyrestein fikk pasientene to forskjellige behandlinger A og B. Totalt var det 700 pasienter som deltok i studien og 80% av dem ble helt friske av behandlingen. For behandling A var det 78% som ble helt friske og for behandling B var det 83%. Så man kan tenke at behandling B er bedre enn behandling A.

Behandling A |

Behandling B |

Total |

|

|---|---|---|---|

Små stein |

93% (81/87) |

87% (234/270) |

88% (315/357) |

Store stein |

73% (192/263) |

69% (55/80) |

72% (247/343) |

Total |

78% (273/350) |

83% (289/350) |

80% (562/700) |

Men når vi ser litt nærmere på hvor store nyresteinene var før behandling, så er det et annet bilde (se tabellen over). De små nyrestein er enklere å behandle og det er 88% totalt som ble helt friske av behandlingen. Pasienter som fikk behandling A ble helt friske i 93% av tilfellene og pasienter som fikk behandling B ble helt friske i 87% av tillfellene. For de store stein, ble 78% av pasienter med behandling A helt friske og bare 69% av pasienter med behandling B. Vi konkluderer at behandling A er bedre for pasienter med små stein og bedre for pasienter med store stein, men dårligere for alle pasienter sammen. Grunnen for denne tilsynelatende paradoksen er at pasienter med små stein fikk som oftest behandling B og pasienter med store stein fikk som oftest behandling A.

Vi konkluderer at det er absolutt nødvendig å samle inn alle nødvendige variablene. Ellers kan vi komme til helt feil konklusjon. På den andre siden, så bør vi ikke samle inn for mange unødvendige variabler. Ellers gjør vi det bare vanskeligere for modellene våre å lære sammenhenger mellom variablene. Hvis vi samler inn veldig mange variabler så riskerer vi at det er tilfeldige sammenhenger mellom variablene i treningsdata som ikke lar seg generalisere. Så for å komme tilbake til hvilke data som vi skal samle inn. Vi må ha en plan for hvordan vi skal bruke data. Vi trenger ikke å samle inn data som vi ikke har tenkt å bruke. Vi må huske at strukturerte data er enklere enn ustrukturerte data å håndtere. Så hvis vi kan ungå det, så bør vi ikke samle inn tekst, men heller flervalgsspørsmål. Før vi samler inn data må vi også vurdere om data er balanserte, det vil si om det er like mange av forskjellige grupper. Hvis det er veldig store forskjeller kan vi vurdere å heller bruke en case-control studiedesign for å utjevne gruppestørrelsene.

Spørreskjema#

Når vi lager en spørreskjema, så er det viktig å bruke enkle ord og begreper. Alle som fyller ut skjemaet bør forstå det, ellers riskerer vi feil svar. Vi bør unngå for lange spørsmål. En fare er også å bruke ledende spørsmål. Hvis vi spør «Hva synes du er det beste med denne nettsiden?», så er det umulig å svare at det ikke var noe du likte med nettsiden. Spørsmål bør helst være lukkede. Hvis de er åpne, så fører det til tekstsvar og ustrukturerte data som er vanskelige å analysere. Spørsmål bør være entydige. Et spørsmål som «Er denne nettsiden spennende og nyttig?» gjør det umulig å vite om et svar av nei betyr at det ikke var spennende eller ikke var nyttig eller verken spennende eller nyttig. Til slutt bør svarkategoriene ikke overlappe. Ellers vet folk ikke hva de skal svare på. Et typisk eksempel er «Hvor gammel er du?» med kategorier under 18, 18-30, 30-50, og 50+. Hva skal man svare når man er akkurat 30, er man 18-30 eller 30-50?

Personopplysninger#

Til slutt må vi snakke litt om personopplysninger. Det er all informasjon som kan identifisere en person. Ifølge generell databeskyttelsesforordning (GDPR), gjelder blant annet IP-adresser, påloggings-ID-er, biometriske identifikatorer, geografiske posisjonsdata, videofilmer, kundelojalitetshistorier, innlegg på sosiale medier og bilder som personopplysninger. Men ofte kan også en kombinasjon av data identifisere en person. For eksempel så publiserte netflix i 2006 anonymiserte filmrangeringer fra brukere. Forskere de-anonymiserte data ved å sammenligne med offentlig tilgjengelige IMDb rangeringer. Med bare to filmrangeringer samt dato fikk de 68% re-identifikasjonssuksess. Det betyr også at det ikke er så lett å anonymisere data. Klart må navn og adresse slettes, men hva mer? Og hvordan kan noe som genetiske data anonymiseres? Innsamling av personopplysninger kan ha etiske og ikke minst juridiske konsekvenser. Når man samler inn persondata i forskning må man alltid konsultere en etisk kommisjon før studiestart. I næringslivet er det ofte ikke nødvendig. Men det anbefales sterkt å konsultere en jurist før man samler inn personopplysninger.

Når man en gang har valgt å samle inn personopplysninger, så vil man ofte publisere resultater basert på de. I så fall er det veldig viktig å ikke publisere noe som er identifiserbart. En typisk måte å unngå å gi ut personopplysninger er å bruke aggregasjon. For eksempel gir statistisk sentralbyrå kun informasjon som gjelder minst 4 personer. Men selv dette må man være forsiktig med. For noen år siden så publiserte et universitet gjennomsnittslønn av alle ansatte i hver gruppe og delt opp etter kjønn. For en gruppe var det kun en kvinne, så de publiserte kun gjennomsnittslønn for alle sammen og for alle men. Men basert på disse data kan man regne ut akkurat hvor mye kvinnen tjente. Så selv om alle data var gjennomsnitt av minst 4 personer, så var det likevel mulig å regne seg til enkelte personopplysninger. Så her gjelder det å være veldig forsiktig.

Bias#

Bias i maskinlæring refererer til systematiske feil i en modell som kan føre til feilaktige eller forvrengte resultater. Bias kan oppstå på ulike måter gjennom hele prosessen med å utvikle og trene maskinlæringsmodeller, og det kan påvirke nøyaktigheten og generaliseringsevnen til modellen.

Det er to hovedtyper av bias i maskinlæring, bias i data og bias i modeller. Bias i data er ofte på grunn av skjevheter i datasettet. Dette oppstår når treningsdataene ikke representerer den virkelige verden på en nøyaktig måte. For eksempel, hvis en modell for ansiktsgjenkjenning trenes på et datasett som overrepresenterer én etnisk gruppe, vil modellen kunne ha vanskeligere for å gjenkjenne ansikter fra andre grupper.

Bias i modellen eller algoritmisk bias skjer når selve læringsalgoritmen har innebygde antagelser som kan føre til systematiske feil. For eksempel kan enkelte modeller ha for sterke antagelser om sammenhenger i dataene som ikke er riktige i alle tilfeller. Et eksempel er når vi bruker lineær regresjon for å modellere ikke-lineære sammenhenger.

Bias er problematisk fordi det fører til feilaktige resultater og manglende generalisering. Modellen kan for eksempel produsere skjevheter i sine prediksjoner, noe som kan ha store konsekvenser, spesielt innen områder som helse, rettssystemet, eller ansettelser. Dette har åpenbare etiske og juristiske implikasjoner siden bias kan føre til diskriminering eller urettferdig behandling av visse grupper.

For å redusere bias bør vi alltid bruke representative datasett som er balanserte og mangfoldige. I tillegg er det viktig å evaluere modellens ytelse på ulike demografiske grupper for å oppdage bias.